SBS 뉴스

[오그랲]

⚡ 스프 핵심요약

미국과 이스라엘의 이란 공습에서 팔란티어와 앤트로픽의 AI 모델이 활용되어 군사 작전의 판도를 바꾸는 '게임 체인저'로 부상하며 AI의 윤리적 사용 문제가 크게 대두되었습니다.

앤트로픽은 미국인 대규모 감시와 인간 감독 없는 완전 자율 무기 사용에 반대하며 국방부와 갈등을 겪었지만, 오픈AI는 국방부의 모든 합법적 사용 조항을 수용하며 대조적인 행보를 보였습니다.

AI 기업들의 윤리적 원칙이 시험대에 오르면서, AI 안전을 위한 명확한 법적, 제도적 장치 마련의 중요성이 강조되고 있습니다.

미국과 이스라엘이 이란을 전격 공격하면서 다시금 전쟁의 불길이 번지고 있습니다. 주식 시장은 출렁였고 유가 급등 가능성도 커지고 있죠. 이번 전쟁에서 주목할 건 전황만이 아닙니다. 미군의 공습 과정에서 AI가 활용된 것으로 알려지면서 AI의 윤리적 문제도 커지고 있죠. 전쟁의 판도를 바꾸는 게임 체인저로 떠오른 AI. 오늘 오그랲에서는 AI와 전쟁을 둘러싼 논쟁을 다양한 데이터와 그래프로 분석해 보겠습니다.

전투에 투입된 AI? '장대한 분노'에 사용된 클로드 모델

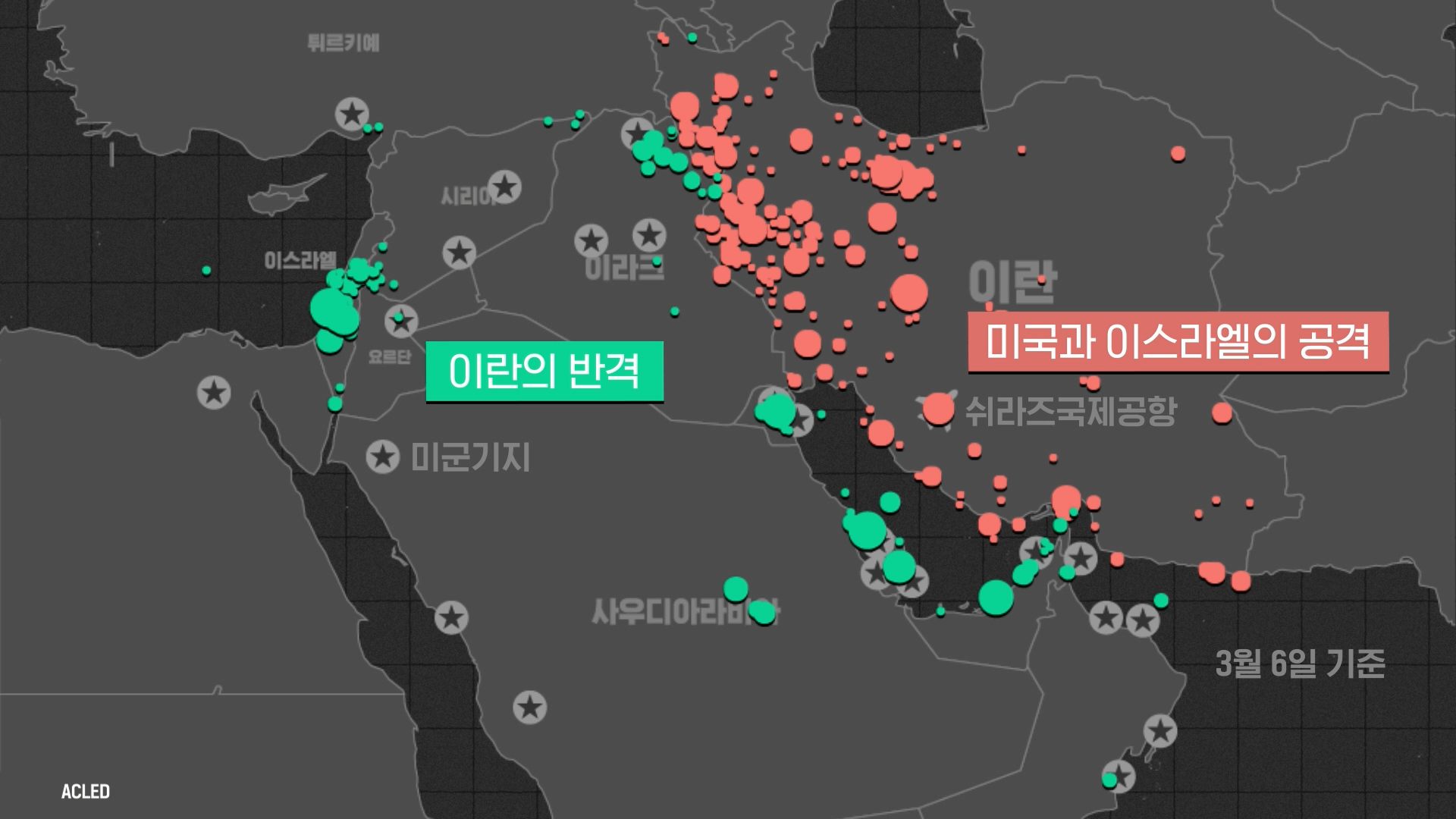

지난 2월 28일 토요일, 현지 시간으로 오전 9시 45분쯤에 이란 수도 테헤란에서 강력한 폭발이 발생합니다. 미국과 이스라엘이 예방 전쟁 차원에서 이란을 향해 선제타격을 가한 거였죠. 미사일 타격은 테헤란만을 향하지 않았습니다. 이란의 여러 주요 도시가 동시 다발적으로 공습 대상이 되었어요.

이란의 공항과 공군기지뿐 아니라 각지에 있는 군사 목표물을 향해 미국과 이스라엘은 미사일을 퍼부었습니다. 이란도 곧바로 반격에 나서면서 이스라엘과 주변 중동 국가에 있는 미군 기지를 향해 미사일을 발사했습니다. 공습 과정에서 이란 남부 지역의 초등학교에서 100명이 넘는 어린이 사망자가 발생하는 안타까운 일도 발생했습니다.

장대한 분노, 혹은 사자의 포효로 불리는 이 작전으로 이란의 지도자 알리 하메네이는 공식적으로 사망했죠. 이란 수뇌부를 향한 정밀 타격, 그리고 주요 거점들을 파괴할 수 있었던 배경에는 AI의 역할이 있었습니다.

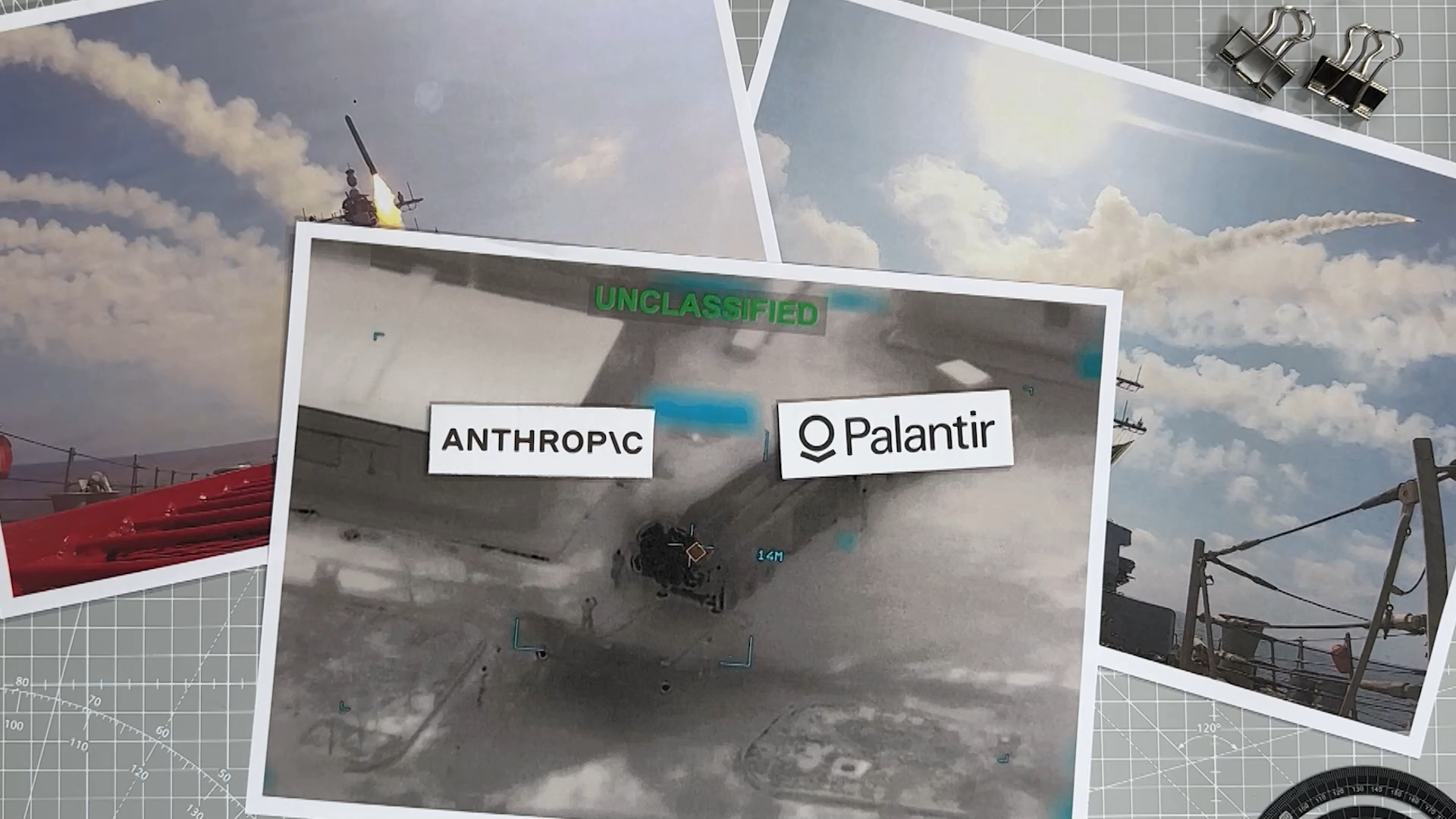

외신 보도에 따르면 이번 작전에서 미국은 앤트로픽과 팔란티어의 AI를 활용한 것으로 알려졌어요. 팔란티어의 고담은 이란의 주요 군사시설과 지도부의 은신처를 식별해 내고, 또한 레이더와 드론 데이터를 활용해 이란 방공망의 허점을 찾아내는 데 활용된 것으로 알려졌습니다. 앤트로픽의 클로드 모델은 공습을 실행하기 직전까지 수만 가지의 공격 시나리오를 시뮬레이션해 미국과 이스라엘의 피해를 최소화할 수 있는 전략을 분석했습니다.

평소라면 자국 AI의 위력을 내세웠을 트럼프가 이번엔 침묵했어요. 공교롭게도 공습 불과 몇 시간 전에 트럼프가 앤트로픽을 '좌파 AI'라고 맹비난하며 모델 사용 금지령을 내렸거든요. 자신이 퇴출한 기술이 자신의 작전을 성공시킨 아이러니한 상황이 벌어진 거죠.

물론 미군이 트럼프의 명령을 어긴 건 아닙니다. 이미 사용 중인 곳들이 있어 6개월의 유예 기간을 두었거든요.

그런데 왜 이렇게 트럼프가 앤트로픽에게 화가 난 걸까요? 사건의 진상을 알기 위해선 지난 1월에 있었던 베네수엘라 마두로 생포 작전 이야기를 살펴봐야 합니다.

사용 제약 없는 모델 달라는 트럼프 vs 레드 라인은 넘길 수 없다는 앤트로픽

지난 1월 3일 미국은 군사 작전을 통해 베네수엘라의 니콜라스 마두로 대통령을 체포해 왔습니다. 이미 작년부터 두 국가 사이의 갈등이 있긴 했지만 당시엔 베네수엘라 외부에서 국지적인 충돌 정도였죠. 하지만 1월 3일에 전격적으로 작전이 시행되면서 베네수엘라 영토 내에서도 교전이 발생했습니다.

트럼프 대통령은 마두로 정권이 미국 내 마약 판매를 기획하고 방조했다는 명분으로 체포했다고 밝혔지만 국제법으로나, 국내법으로나 논란이 많았습니다. 외교 정치적 문제를 다루기엔 너무 내용이 많으니 오늘은 AI 이야기에 집중해 보겠습니다.

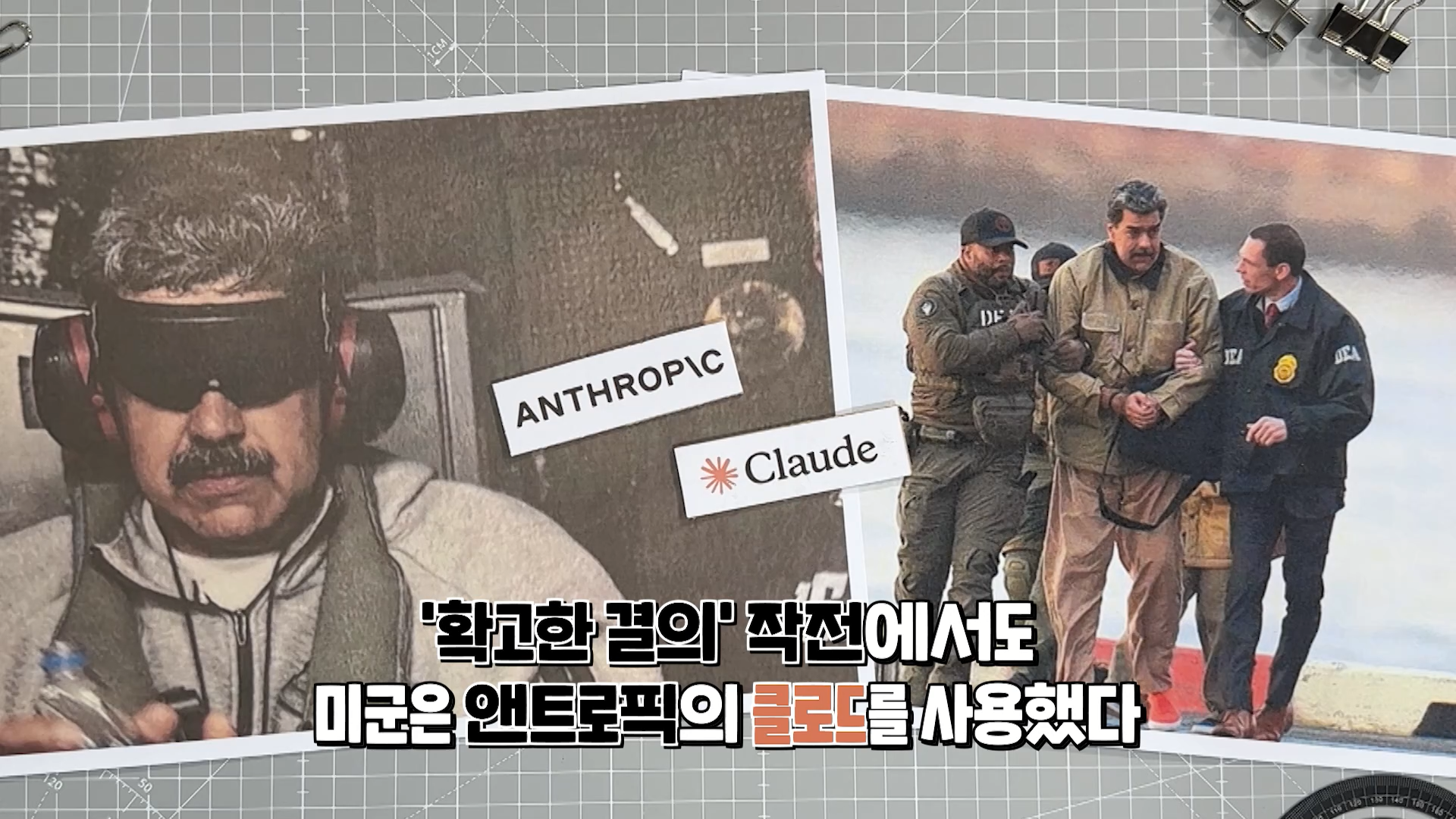

마두로를 납치해 오는 '확고한 결의' 작전에서도 미군은 앤트로픽의 클로드를 사용한 걸로 알려졌어요. 단순히 작전을 준비하는 단계뿐만 아니라, 작전 수행 중에도 사용했다는 얘기가 나올 정도로 활용도가 컸죠. 그 덕이었을까요? 이 작전에서 미군 사망자는 없었고, 베네수엘라에서만 83명의 사망자가 발생했습니다.

그런데 앤트로픽 입장에서는 이게 껄쩍찌근 한 겁니다. 국방부와의 계약은 계약인데 전투 과정에서도 우리 모델이 사용되었고, 그 과정에서 살상도 있었다고 하니까요.

외신 보도에 따르면 앤트로픽은 팔란티어에 연락해서 이번 작전에 진짜 자신들의 모델이 사용되었는지 여부를 확인했다고 합니다. 보도에 나온 관계자에 따르면 군사 작전에 앤트로픽의 모델이 사용되는 것을 앤트로픽 측이 반대하는 뉘앙스의 대화가 오갔다고 하죠. 물론 이에 대해 앤트로픽은 부인하고 있습니다. 그런 논의 없이 단순히 기술적인 이야기만 나눴다고 말하고 있거든요.

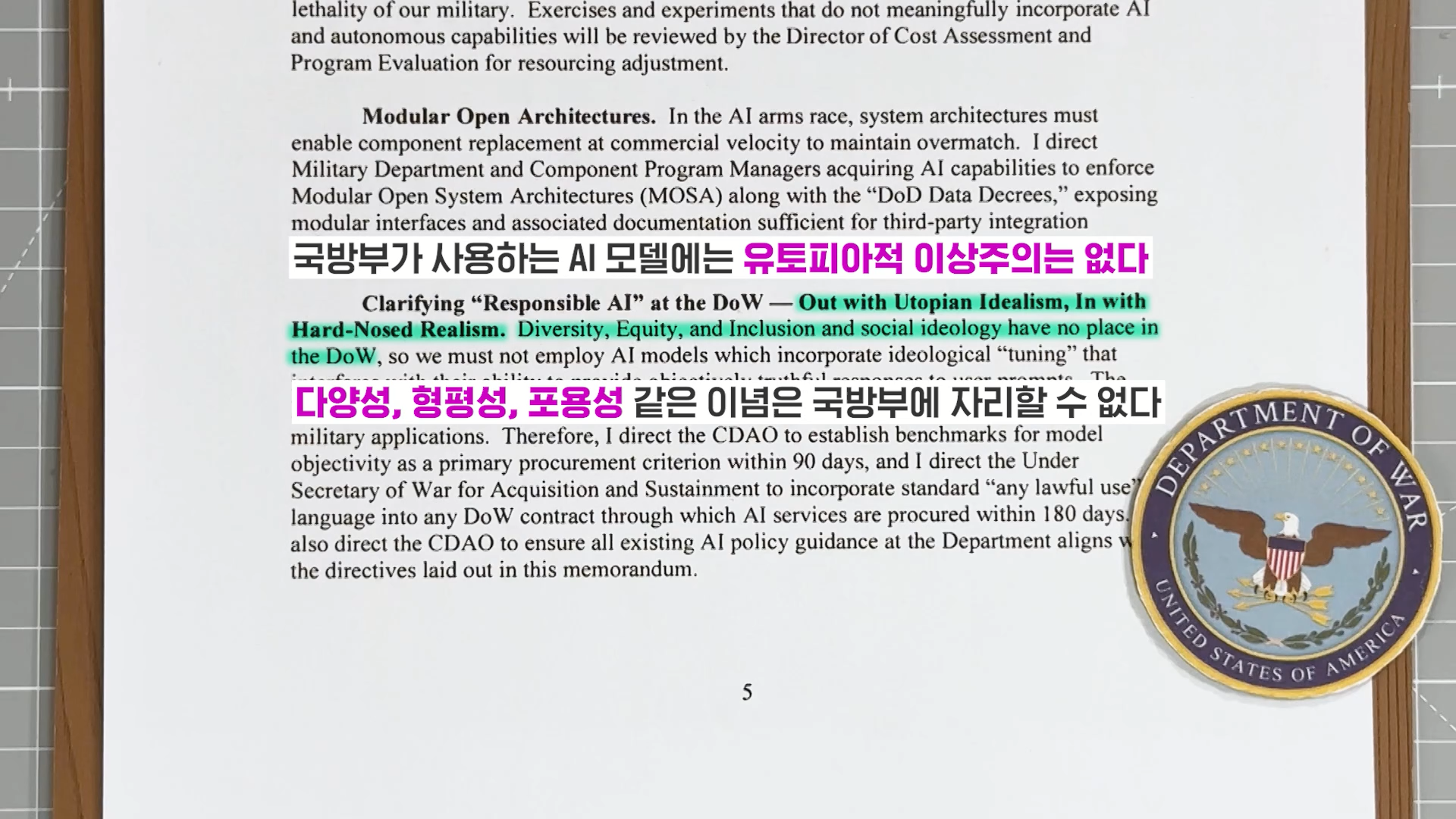

하지만 팔란티어는 이 내용을 펜타곤에 보고하였고, 보고를 들은 국방부 입장에선 앤트로픽이 괘씸한 겁니다. 감히 군사 작전에 일개 기업이 이의를 제기하냐는 생각이 든 거죠. 그래서 국방부는 이 문서를 AI 기업들에게 보내며 압력을 가했어요.

"국방부가 사용하는 AI 모델에는 유토피아적 이상주의는 없다" "다양성, 형평성, 포용성 같은 이념은 국방부에 자리할 수 없다"

사실 앤트로픽이 AI 군사적 이용 자체에 반대하는 건 아닙니다. 앤트로픽은 AI 기업으로는 최초로 미국 기밀 클라우드에 자신들의 AI 모델을 적용한 기업이거든요.

딱 2가지 사안에 대해서만 반대하고 있어요. 첫째는 미국인에 대한 대규모 감시, 둘째는 인간 감독 없는 완전 자율 무기.

하지만 미 국방부에서는 두 조건이 실현 불가능한 것이라고 판단하고 있어요. 국방부에서 운영하는 프로그램에는 딱 구분 짓기에 모호한 영역이 존재한다는 거죠. 게다가 법적 규제가 아니라 민간 기업의 기준에 따라 국방부가 움직이는 것도 모양새가 빠지고요.

국방부 입장에선 앤트로픽을 포기하고 다른 모델을 고려할 수도 있겠지만 앤트로픽의 클로드 모델의 성능이 가장 뛰어나다는 게 문제입니다.

클로드를 포함해 프런티어 모델 3가지를 가지고 모의 전쟁 게임을 진행해 보면 클로드의 승률이 가장 높습니다. 데드라인 없는 개방형 전쟁 게임에서 클로드의 승률은 6전 전승 데드라인이 있는 경우 승률이 33%대로 떨어지긴 하지만 전체 모델 가운에 클로드의 성능이 가장 뛰어나죠.

피트 헤그세스 국방장관은 다리오 아모데이 CEO와 만나 갖은 경고와 함께 최후통첩을 날렸지만 최종적으로 앤트로픽은 국방부의 제안을 받아들이지 않았습니다. 그 결과가 앞서 살펴본 트럼프의 '좌파 AI' 딱지와 금지령이었죠.

헤그세스 국방장관은 더 강한 반응을 보였어요. 앤트로픽을 두고 '오만과 배신의 극치'라고 쏘아붙이며 국가안보에 대한 공급망 위험 기업으로 지정한다고 발표했죠. 공급망 위험 기업이 되면 미군은 물론 미군과 사업을 하는 파트너 기업과도 거래가 사실상 불가능해져요.

앤트로픽은 전례 없는 조치라며 법적 조치를 고려한다고 강하게 반발하고 있죠. 일단 국방부와 앤트로픽이 다시 협상 테이블에 앉았다는 보도가 나오고는 있어서 상황을 조금 더 지켜볼 필요가 있습니다.

트럼프 백기투항 요구에 거부한 놈 vs 순응한 놈 vs 좋아한 놈

최후통첩 전부터 앤트로픽이 강경한 입장을 내보이자 국방부도 대체 모델을 찾아 나섰어요. 사실 국방부가 앤트로픽하고만 접점을 넓힌 건 아니었어요. 2025년 여름에 앤트로픽을 포함해서 오픈AI, xAI, 구글 이렇게 AI 4대 천황과 각각 최대 2억 달러에 달하는 프로젝트를 계약할 정도였죠.

그중에서도 가장 트럼프 행정부와 친화적인 xAI는 국방부가 요구한 '모든 합법적 사용' 조항을 조건 없이 바로 수용했어요. 참고로 일론 머스크는 앤트로픽의 헌법 문구를 문제 삼으면서 '앤트로픽이 서구 문명을 증오'한다고 주장하기도 했어요. 현재 xAI의 그록 모델도 미국의 기밀 군사 시스템에서 활용될 수 있게 되었습니다.

국방부는 xAI뿐 아니라 나머지 오픈AI와 구글과도 계약을 진행하고 있어요. 이렇게 AI 기업들 간의 간극이 생기고 분열이 일어나자 AI 기업의 개발자들이 들고 일어서고 있습니다. '우리는 분열되지 않는다'라는 이름의 공개서한에 오픈AI와 구글 직원들이 참여하고 있거든요.

국방부의 압력에 맞서서 AI 기업들 간의 공동의 이해를 구축하기 위해 현재(3월 6일 기준)까지 총 957명의 직원들이 참여했습니다. 오픈AI에서 100명의 직원들이, 구글에서는 무려 857명이 참여할 정도로 연대하는 모습을 보여주고 있어요.

오픈AI와 앤트로픽은 시장의 라이벌이기 이전에, 'AI의 안전'이라는 가치를 두고 갈라선 관계입니다. 샘 올트먼의 거침없는 상업화에 반기를 들고, 나간 다리오 아모데이가 세운 기업이 바로 앤트로픽이니까요. 이번 직원들의 연대가 이례적인 이유도 바로 여기에 있습니다.

아모데이는 오픈AI에서 GPT-2와 GPT-3의 개발 총괄을 담당했던 핵심 연구진이었습니다. 하지만 MS로부터 거액의 투자를 받으면서 오픈AI가 안전보다는 상업화의 길을 걷자 반발한 거죠. 결국 아모데이는 핵심 개발자들을 데리고 오픈AI를 퇴사해 앤트로픽을 세웠습니다.

아모데이는 다른 기업들이 AI 안전팀을 해체해도 꾸준히 관련 연구 진행했어요. 모델에게 높은 도덕적 기준과 책임감을 주입시키기 위해 사내에 AI 철학자가 존재할 정도죠. 또한 AI를 더 잘 이해하기 위한 연구에도 집중했고, 뿐만 아니라 AI가 사회에 미치는 영향에 대해서도 꾸준히 보고서를 내고 있어요. 그러면서도 성능을 놓치지 않고 있습니다.

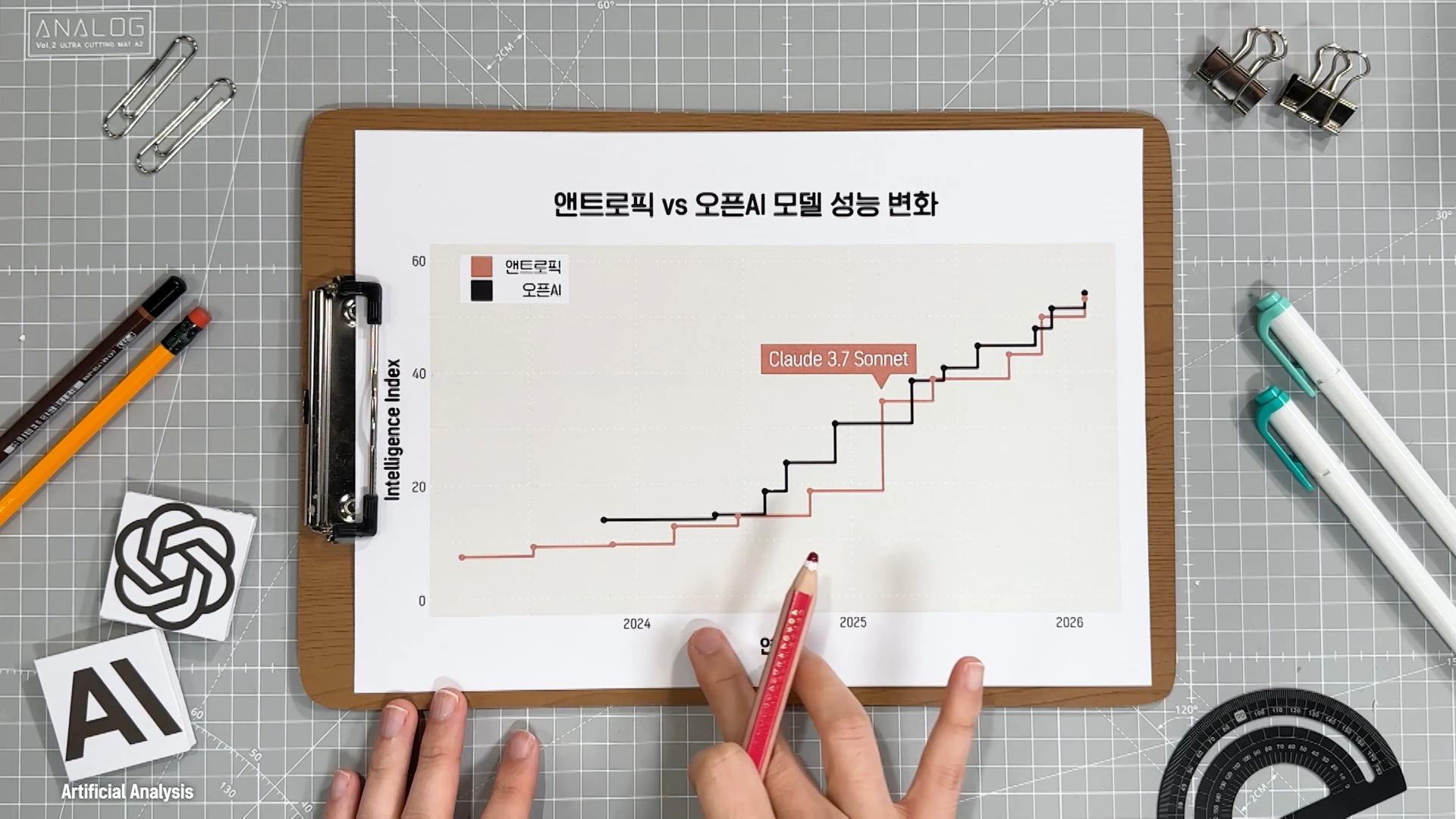

2025년 초반까지는 오픈AI의 모델 성능이 앤트로픽보다 더 좋았어요. 하지만 클로드 3.7 소넷이 처음으로 역전한 뒤에는 서로 앞서거니 뒤서거니 하면서 성능 발전을 이어오고 있죠.

두 기업 간의 라이벌리는 점점 더 수면 위로 드러나고 있어요. 최근 오픈AI가 광고를 시험 도입하자 앤트로픽은 슈퍼볼 광고에서 이걸 저격하기도 했죠.

지난 2월에 인도에서 열린 AI 써밋에서는 이렇게 두 사람이 악수 패싱을 할 정도였고요.

하지만 그럼에도 불구하고 앤트로픽이 국방부와 갈등이 빚어지자 샘 올트먼이 중재에 나서기도 했습니다. 국가의 안보 사안을 민간 기업이 이래라저래라 하는 정부의 우려를 인정하면서도 아모데이의 입장 지지한 거죠.

그런데 웬걸요? 앤트로픽이 공급망 위험 기업으로 지정되자마자 오픈AI는 바로 국방부와 계약을 체결했습니다.

역풍 맞은 오픈AI? 앱 삭제에 QUIT GPT 운동까지

오픈AI가 국방부와 계약을 맺었다는 소식이 전해진 이후 소비자 반응은 냉담 그 자체였습니다. 계약 이후 미국 내에서만 챗GPT 앱 삭제율이 295%로 증가할 정도였죠. 보통 앱 삭제율이 전날 대비 9% 수준이었는데 엄청나게 폭증한 겁니다. 별점 1점 리뷰도 775%나 급증했어요.

역풍을 세게 맞은 샘 올트먼은 SNS를 통해 이번 계약이 '기회주의적이고 엉성하게 보였다'고 인정하면서도 계약의 방향 자체는 옳았다고 말했어요.

오픈AI는 앤트로픽이 거절한 국방부의 '모든 합법적 사용' 조항을 수용했습니다. 다만 이용자들로부터 강한 비판을 받자 오픈AI는 국방부와의 조항을 수정할 계획이라고 밝혔어요. 이를테면 앤트로픽의 레드라인 중 하나였던 대중 감시 금지 조항을 추가로 넣겠다고 한 거죠.

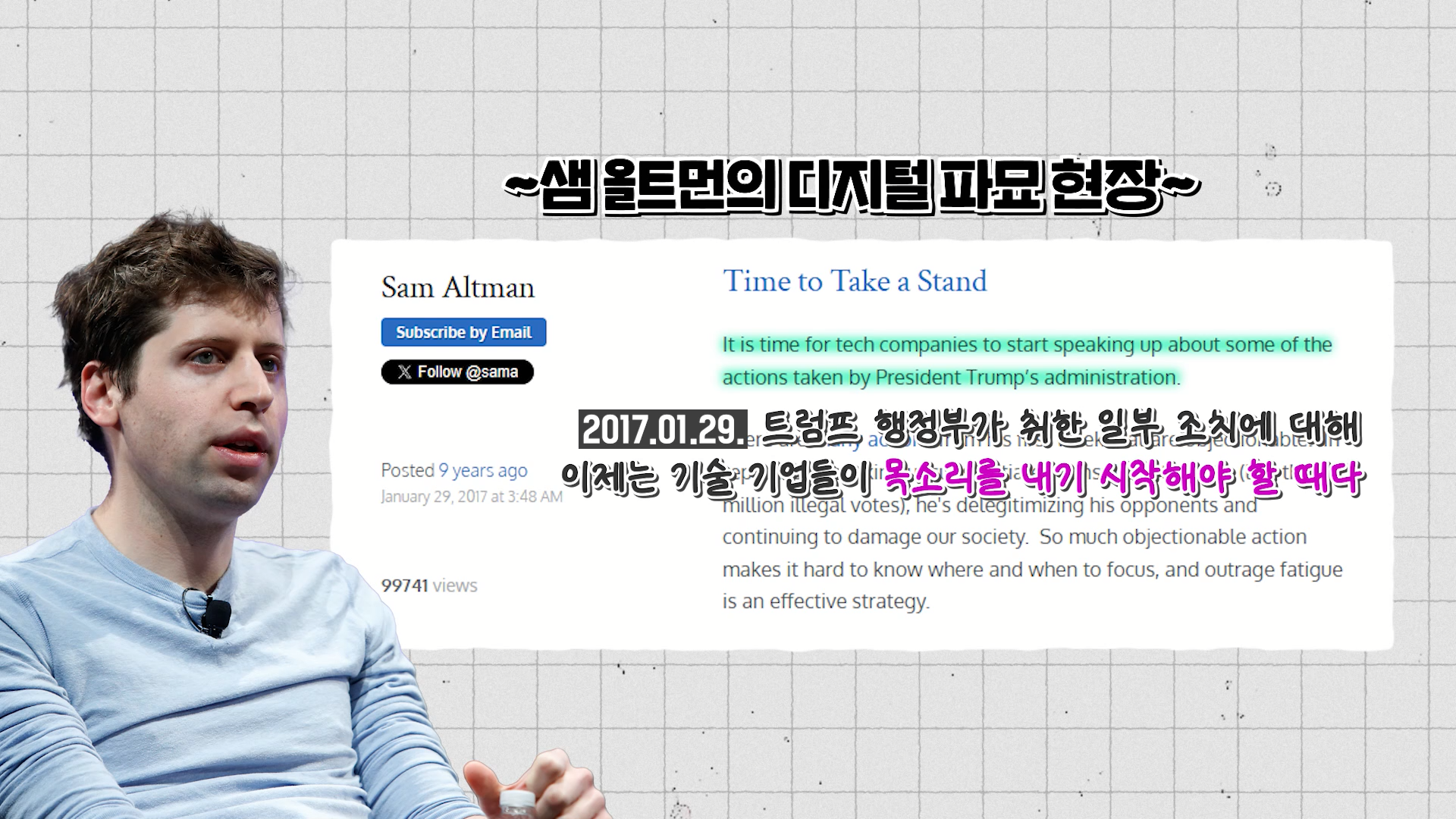

사실 트럼프 1기 때만 해도 샘 올트먼은 가장 적극적으로 트럼프를 비판했던 사람 중 한 명이었어요. 다른 IT 기업들이 힘을 모아서 트럼프에 맞서야 한다고 촉구하기도 했죠. 올트먼이 쓴 예전 블로그 글을 보면 트럼프를 히틀러에 비유할 정도로 강경한 자세를 보였습니다.

하지만 트럼프 2기 행정부가 출범한 이후 태도가 돌변했어요. 트럼프 취임식에 100만 달러의 기부금도 회삿돈이 아닌 개인 자금으로 보냈고, 트럼프 취임식에도 참여했죠. 오픈AI 경영진들도 트럼프를 지지하는 슈퍼팩에 수천만 달러를 기부할 정도로 입장이 180도 바뀐 겁니다.

샘 올트먼은 여기서 멈추지 않고 있습니다. 국방부에 이어 NATO와의 계약도 검토 중이라는 보도가 나왔거든요.

친 트럼프 모습과 국방부 계약 건이 터지면서 오픈AI 불매운동 바람도 커지고 있습니다. 챗GPT 유료 구독을 취소하자는 QUIT GPT 운동에만 현재 250만 명이 참여하고 있습니다. 과거보다 성장세가 주춤해진 오픈AI 입장에선 이러한 불매 운동이 상당히 부담스러울 수 있어요.

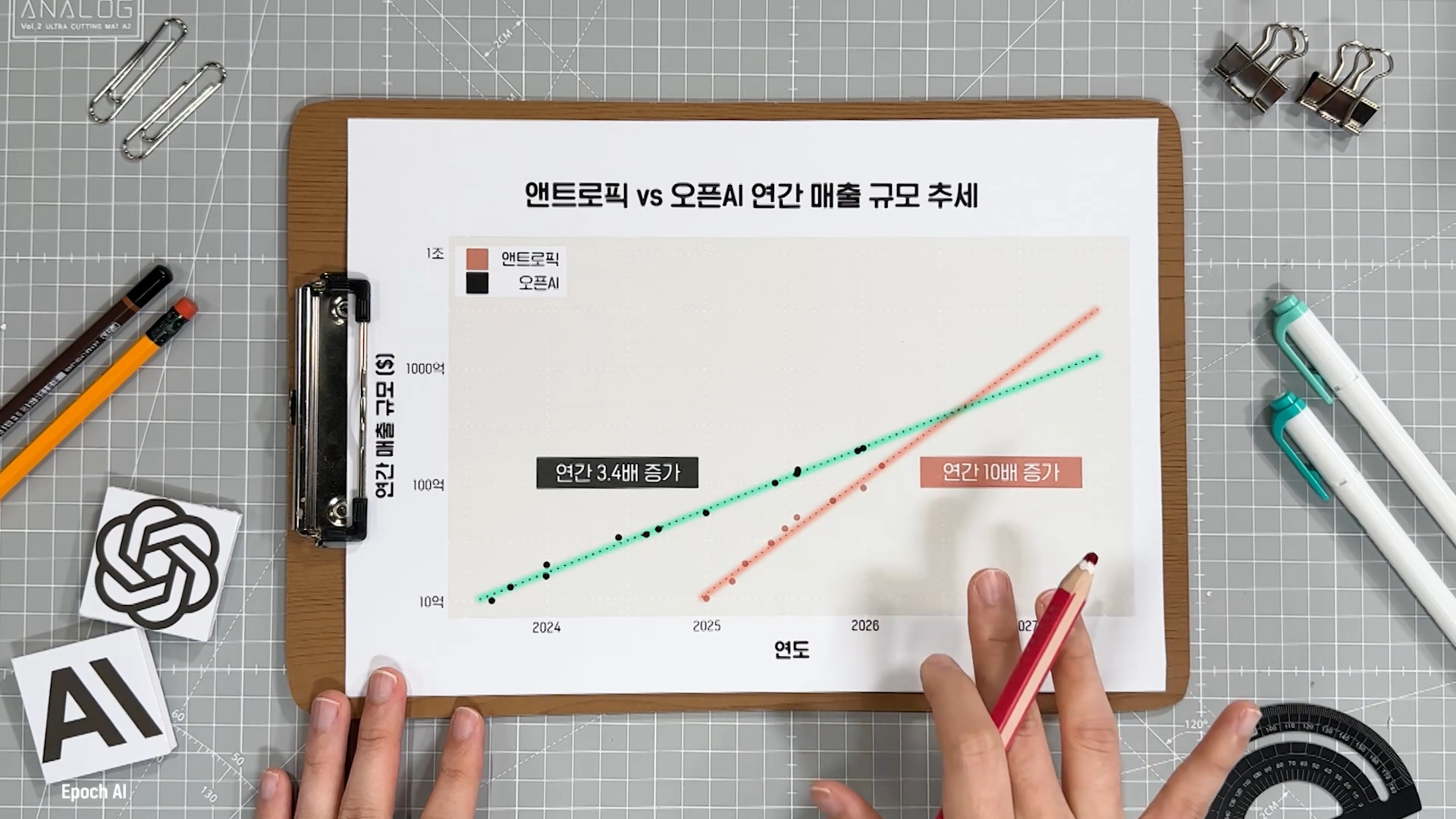

최근 오픈 AI는 연간 3.4배 성장하는 추세를 보이고 있어요. 이 흐름도 나쁜 건 아니지만 앤트로픽과 비교하면 차이가 심합니다. 앤트로픽은 10억 달러 돌파 이후 매년 10배씩 성장하는 모습이거든요. 이러한 추세가 지속된다면 올해 중반에 두 기업 사이의 연간 매출이 역전될 수도 있죠.

앤트로픽은 AI 안전을 챙기는 이미지를 갖게 되면서 이용자들의 선택을 받고 있어요. 가뜩이나 클로드 모델의 가파른 성능 향상으로 개발자 이용자를 끌어모으던 앤트로픽은 이번 갈등이 도리어 호재로 작용하고 있죠. 사용자가 급격히 늘어나면서 접속 오류가 날 정도였더라고요.

우리나라에서도 변화의 흐름이 보이고 있습니다. 지난달 국내 앤트로픽 결제 금액이 1년 전보다 10배 이상 급증할 정도죠.

과연 지금이 오픈AI에서 앤트로픽으로 무게추가 옮겨지는 시점이 될까요?

AI가 본격적으로 전쟁터에 투입되면서 기업들의 윤리적 원칙이 시험대에 올랐습니다. 앤트로픽이 국방부와 갈등을 빚으면서 AI 안전의 마지노선을 지켰다고 평가받지만, 정말로 AI 안전에 진심인 걸까요? 다른 기업보다는 나을 수 있지만 앤트로픽도 점점 후퇴하고 있습니다.

얼마 전 앤트로픽에서 안전팀을 이끌던 책임 연구자가 퇴사했습니다. 안전보다 상업성을 우선시하고 있다며 회사를 비판하면서 말이죠. 마치 아모데이가 샘 올트먼에게 했던 것처럼 똑같은 일이 반복되고 있는 겁니다. 거기에 더해 앤트로픽의 안전 지침도 점점 완화되고 있죠. 창립 당시의 가치와 약속은 점점 흐릿해지고 있습니다.

기업들이 선의를 갖고 있다고 하더라도 결국 정부의 정책 방향에 따라 움직일 수밖에 없을 겁니다. AI 안전을 지키기 위해선 결국 명확한 법적, 제도적 장치마련이 우선이겠죠. 오늘 준비한 오그랲은 여기까지입니다. 긴 글 끝까지 읽어 주셔서 진심으로 감사합니다.

참고자료

- Iran Crisis Live Data | ACLED

- AI Arms and Influence: Frontier Models Exhibit Sophisticated Reasoning in Simulated Nuclear Crises | Kenneth Payne (2026)

- We Will Not Be Divided

- Frontier Language Model Intelligence, Over Time | Artificial Analysis

- Anthropic could surpass OpenAI in annualized revenue by mid-2026 | Epoch AI

글 : 안혜민 디자인 : 안준석 인턴 : 김수영

Copyright Ⓒ SBS. All rights reserved. 무단 전재, 재배포 및 AI학습 이용 금지

SBS 뉴스